Този инструмент кара AI моделите да халюцинират котки, за да се борят с нарушаването на авторските права

Художници и компютърни учени тестват нов метод да попречат на изкуствения разсъдък да извлича изображения, предпазени с авторски права: „ отровете “ AI моделите с визии на котки.

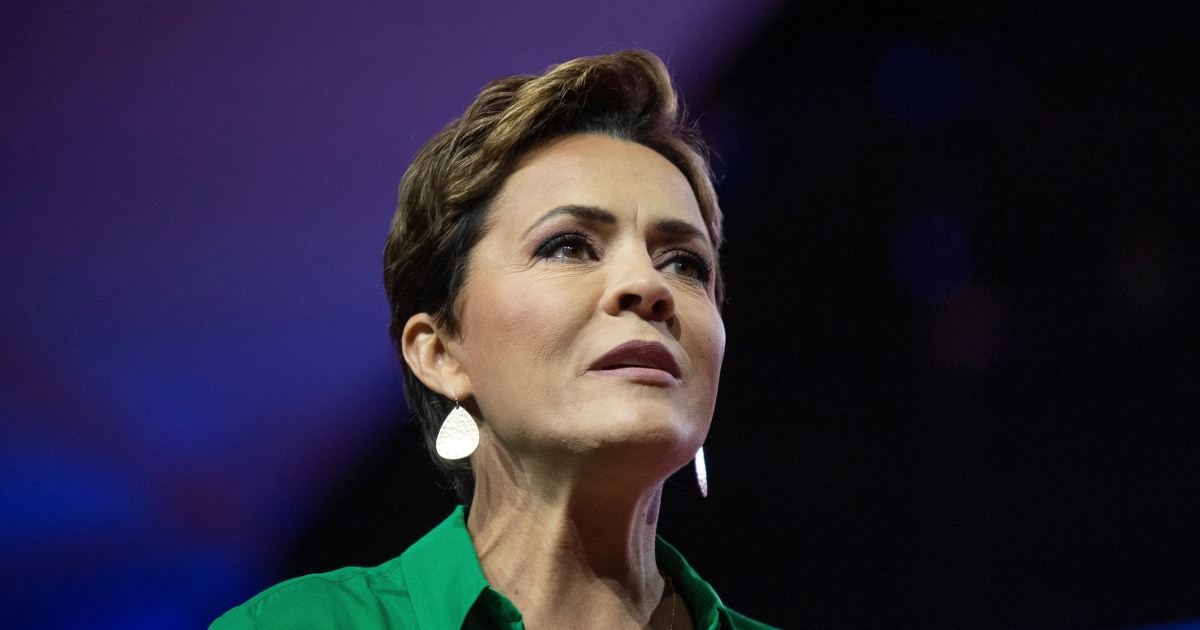

Инструмент, наименуван Nightshade, пуснат през януари от откриватели от Чикагския университет, трансформира изображенията по дребни способи, които са съвсем невидими за човешкото око, само че наподобяват фрапантно разнообразни от AI платформите, които ги гълтам. Художници като Karla Ortiz в този момент „ защитят “ своите творби на изкуството, с цел да ги предпазят от сканиране и репликиране от стратегии за текст във фотография като DreamUp на DeviantArt, Stable Diffusion на Stability AI и други.

„ Това направи ми усещане, че огромна част от това е в действителност цялата моя работа, цялата работа на моите връстници, цялата работа на съвсем всеки художник, който познавам “, сподели Ортис, концептуален художник и илюстратор, чието портфолио й обезпечи работа за планиране на образни детайли за планове за филми, телевизия и видео игри като „ Междузвездни войни “, „ Черната пантера “ и Final Fantasy XVI.

„ И всичко беше направено без ничие единодушие — без заем, без отплата, без нищо “, сподели тя.

Nightshade се възползва от обстоятелството, че AI моделите не „ виждат “ по метода, по който хората го вършат, сподели ръководителят на проучването Шон Шан.

„ Машините виждат единствено огромен набор от цифри, нали? Това са стойности на пиксели от нула до 255 и за модела това е всичко, което виждат “, сподели той. Така Nightshade трансформира хиляди пиксели – капка в кофата за общоприети изображения, които съдържат милиони пиксели, само че задоволително, с цел да подмами модела да види „ нещо, което е изцяло друго “, сподели Шан, четвърта година докторант в Чикагския университет.В документ, който ще бъде показан през май, екипът разказва по какъв начин Nightshade автоматизирано избира идея, която има намерение да обърка AI стратегия, отговаряща на дадена подкана - вграждане на „ кучешки “ фотоси, да вземем за пример, с набор от пикселни изкривявания, които да се чете като „ котка “ на модела.

След като зареди 1000 едвам доловимо „ отровени “ фотоси на кучета в инструмент за изкуствен интелект за текст във фотография и изиска изображение на куче, моделът генерира нещо несъмнено не е кучешко.

Целевите изкривявания на Nightshade обаче не постоянно стават котешки. Програмата взема решение за всеки случай каква различна идея има намерение да „ видят “ своите AI цели. В някои случаи, сподели Шан, са нужни единствено 30 нощни фотоси, с цел да се токсини модел по този метод.

Бен Джао, професор по компютърни науки, който управлява лабораторията на Чикагския университет, създала Nightshade, не Не очаквайте всеобщо нахлуване на инструмента някъде покрай равнище, което би заплашило да смъкна генераторите на AI изображения. Вместо това той го разказа като „ копие “, което може да направи някои по-тесни приложения задоволително неизползваеми, с цел да принуди фирмите да заплащат, когато изтриват работата на художници.

„ Ако сте създател от всевъзможен вид, в случай че вършиме фотоси, да вземем за пример, и не желаете безусловно вашите фотоси да бъдат въведени в подготвителен модел — или сходства на вашите деца, или вашите лични сходства да бъдат въведени в модел — тогава Nightshade е нещо, което може да обмислите, ” сподели Джао.

Инструментът е безвъзмезден за потребление и Джао сподели, че има намерение да го резервира по този метод.

Модели като Stable Diffusion към този момент оферират „ отводи “, тъй че артистите да могат да кажат на наборите от данни да не употребяват тяхното наличие. Но доста притежатели на авторски права се оплакаха, че разпространяването на AI принадлежности изпреварва напъните им да защитят работата си.

Разговорът към отбраната на интелектуалната благосъстоятелност прибавя към по-широк набор от етични опасения по отношение на AI, в това число разпространяването на deepfakes и въпроси по отношение на границите на водния знак за ограничение на тези и други злоупотреби. Въпреки че има възходящо самопризнание в границите на AI промишлеността, че са нужни повече защитни ограничения, бързото развиване на технологията — в това число по-нови принадлежности за текст към видео като Sora на OpenAI — тревожи някои специалисти.

„ Аз не „ Не знам, че ще направи доста, тъй като ще има софтуерно решение, което ще бъде контрареакция на тази офанзива “, сподели Соня Шмер-Галундер, професор по ИИ и нравственос в Университета на Флорида, за Nightshade.

Докато планът Nightshade и други като него съставляват добре пристигнал „ протест “ против AI моделите при липса на смислена регулация, сподели Шмер-Галундер, разработчиците на AI евентуално ще поправят стратегиите си, с цел да се защитят против сходни контрамерки.

Изследователите от Чикагския университет признават вероятността от „ евентуални отбрани “ против отравянето на изображенията на Nightshade, защото AI платформите се актуализират, с цел да филтрират данни и изображения, за които се подозира, че са минали през „ необикновена смяна “.

Джао счита, че е незаслужено да се трансферира тежестта върху обособените хора да прогонят AI моделите надалеч от техните изображения като начало.

„ Колко компании смятате би трябвало да отидеш при обещано лице, с цел да му кажеш да не нарушава правата ти? “ той сподели. „ Вие не казвате: „ Да, в действителност би трябвало да подписвате формуляр всякога, когато пресичате улицата, който споделя: „ Моля, не ме удряйте! “ на всеки водач, който минава. “

Междувременно Ортис сподели, че вижда Nightshade като потребна „ офанзива “, която обезпечава известна степен на отбрана на работата й, до момента в който търси по-силни в съда.

„ Nightshade просто споделя: „ Хей, в случай че вземете това без моето единодушие, това може да има последици “, сподели Ортис, който е част от групов иск заведено против Stability AI, Midjourney и DeviantArt през януари 2023 година с изказване за нарушение на авторски права.

Съд в края на предходната година отхвърли някои от причините на ищците, само че им остави отворена вратата да подадат изменено дело, което направиха през ноември, като прибавиха Runway AI като ответник. В предложение за отменяне по-рано тази година Stability AI твърди, че „ самото подражаване на естетически жанр не съставлява нарушаване на авторските права на което и да е произведение. “

Stability AI не разяснява. Midjourney, DeviantArt и Runway AI не дадоха отговор на претенции за коментар.

Brian Cheung